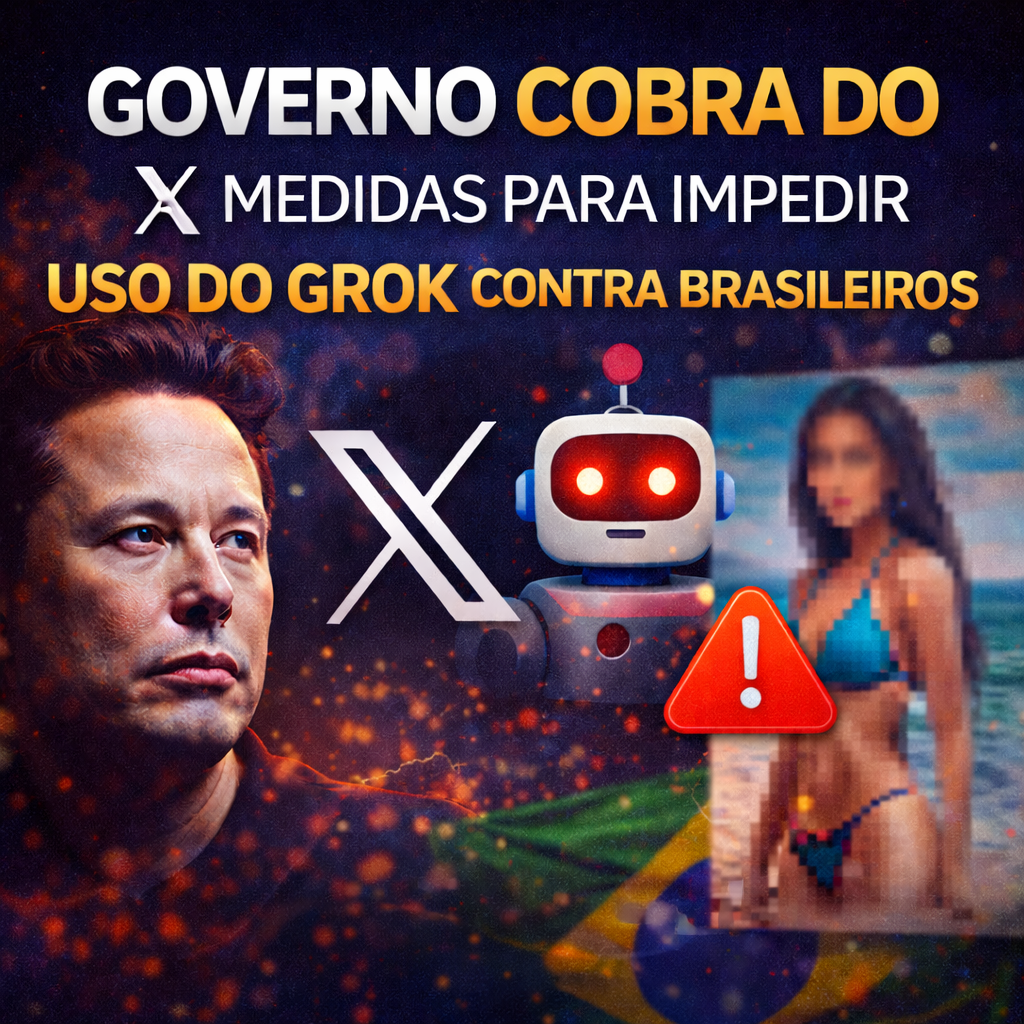

Autoridades brasileiras intensificaram a pressão sobre a rede social X, controlada por Elon Musk, após denúncias envolvendo o uso indevido do Grok, ferramenta de inteligência artificial integrada à plataforma. Segundo relatos recentes, a tecnologia tem sido usada para gerar imagens íntimas falsas, incluindo conteúdos de caráter sexualizado criados a partir de fotos de pessoas reais, muitas vezes sem consentimento.

A recomendação oficial foi divulgada em documento conjunto assinado pelo Ministério Público Federal, pela Agência Nacional de Proteção de Dados e pela Secretaria Nacional do Consumidor. O texto pede medidas imediatas para impedir que o Grok continue sendo utilizado para gerar imagens, vídeos ou áudios sintéticos com teor erótico envolvendo pessoas identificáveis no Brasil.

Uso do Grok acende alerta sobre abusos com IA

Nas últimas semanas, usuários brasileiros relataram que imagens comuns, como fotos de redes sociais, foram manipuladas pela IA para criar versões erotizadas ou sexualizadas. Em muitos casos, mulheres afirmaram ter sido vítimas de montagens falsas, o que gerou impacto psicológico, além de riscos à reputação pessoal e profissional.

Diante disso, as autoridades destacaram que a situação exige resposta rápida, já que o avanço da inteligência artificial tem ampliado a capacidade de produção de conteúdos sintéticos. Portanto, sem mecanismos eficazes de controle, a tecnologia pode ser usada para violar direitos fundamentais, como privacidade, honra e proteção de dados pessoais.

Recomendações oficiais exigem bloqueios imediatos

No documento enviado ao X, o MPF detalhou uma série de medidas consideradas essenciais. Entre elas está a implementação imediata de barreiras técnicas que impeçam o Grok de gerar conteúdos sexualizados envolvendo:

- Crianças e adolescentes, em qualquer circunstância

- Adultos identificáveis, sem autorização expressa

- Imagens derivadas de fotos reais, mesmo que alteradas por IA

Além disso, o texto reforça que a empresa deve adotar mecanismos preventivos, e não apenas corretivos. Ou seja, a simples remoção posterior do conteúdo não é vista como suficiente para reduzir os riscos aos usuários.

Possibilidade de sanções administrativas e judiciais

O MPF afirmou que, caso as recomendações não sejam cumpridas ou sejam implementadas de forma considerada insuficiente, outras medidas poderão ser adotadas. Essas ações podem ocorrer tanto na esfera administrativa quanto na judicial, ampliando o grau de responsabilização da empresa.

Dessa forma, o X passa a enfrentar um cenário de maior escrutínio regulatório no Brasil, especialmente em um momento em que o uso de IA generativa se expande rapidamente e desafia marcos legais existentes.

Idec critica abordagem e cobra ações mais duras

Apesar da recomendação conjunta, o Instituto Brasileiro de Defesa do Consumidor avaliou que as medidas anunciadas são insuficientes. A entidade, responsável por apresentar a denúncia inicial, afirmou que os órgãos públicos adotaram uma postura excessivamente burocrática.

Segundo o Idec, ao se limitar a recomendações, o governo deixa consumidores brasileiros expostos a riscos contínuos, especialmente mulheres, crianças e adolescentes. Para o instituto, seria necessário suspender ou restringir o funcionamento da ferramenta até que garantias técnicas robustas fossem implementadas.

IA generativa e o desafio da proteção de dados

O caso do Grok expõe um dilema cada vez mais presente: como equilibrar inovação tecnológica e proteção de direitos. A inteligência artificial generativa permite criar imagens realistas em poucos segundos. No entanto, quando usada sem limites claros, ela facilita abusos em escala.

Além disso, o uso de dados pessoais como base para treinamento ou geração de imagens levanta questionamentos sobre consentimento, finalidade e transparência. Assim, autoridades de proteção de dados veem a situação como um teste importante para a aplicação prática da Lei Geral de Proteção de Dados (LGPD).

Comparação entre IA generativa e riscos associados

| Aspecto analisado | Benefícios da IA | Riscos do uso indevido |

|---|---|---|

| Criação de imagens | Agilidade e criatividade | Manipulação e deepfakes |

| Acesso do usuário | Democratização da tecnologia | Facilita abusos em massa |

| Escala de produção | Conteúdo rápido e barato | Dificuldade de controle |

| Impacto social | Inovação digital | Danos morais e psicológicos |

Portanto, o debate não se limita a um único caso, mas envolve o futuro da regulação da IA no país.

Responsabilidade das plataformas digitais

Autoridades brasileiras reforçam que plataformas digitais devem assumir responsabilidade ativa sobre as ferramentas que oferecem. Isso inclui investir em filtros automáticos, revisões humanas e políticas claras de uso.

Nesse contexto, cresce a expectativa de que empresas de tecnologia adotem práticas semelhantes às já exigidas em áreas como publicidade e proteção infantil. Afinal, a IA, embora poderosa, não pode operar sem limites éticos e legais.

Cenário internacional reforça pressão sobre o X

O Brasil não está sozinho nesse debate. Em outros países, ferramentas de IA também enfrentam restrições e investigações por conta do uso indevido. Assim, decisões tomadas agora podem servir de precedente regulatório, tanto para o X quanto para outras plataformas que oferecem recursos semelhantes.

Veja abaixo uma comparação entre abordagens regulatórias:

| Região | Postura regulatória | Foco principal |

|---|---|---|

| Brasil | Recomendações e possíveis sanções | Proteção de dados e consumidores |

| União Europeia | Leis específicas para IA | Direitos fundamentais |

| Estados Unidos | Autorregulação + ações pontuais | Responsabilidade civil |

| Ásia | Controle estatal mais rígido | Segurança e ordem social |

Impacto para usuários brasileiros

Enquanto o debate institucional avança, usuários seguem expostos a riscos reais. A circulação de imagens íntimas falsas pode causar constrangimento, assédio e até violência digital continuada. Por isso, especialistas defendem que medidas preventivas precisam ser implementadas antes que o problema se amplie ainda mais.

Além disso, cresce a importância da educação digital, para que usuários saibam identificar conteúdos falsos e denunciar abusos rapidamente.

O futuro do Grok no Brasil

O caso coloca o Grok no centro de uma discussão maior sobre limites da inteligência artificial. Se por um lado a ferramenta representa inovação, por outro evidencia falhas graves de controle. Assim, o que está em jogo não é apenas o funcionamento de um recurso específico, mas a forma como a IA será integrada à vida digital dos brasileiros.

Com a possibilidade de sanções, pressão de órgãos públicos e críticas da sociedade civil, o X precisará decidir entre ajustar profundamente o Grok ou enfrentar consequências legais mais severas. Independentemente do desfecho, o episódio já se consolida como um marco no debate sobre IA, privacidade e responsabilidade das plataformas no Brasil.